东北大学《人工智能的数学基础》,笔者自学参考教材为人工智能的数学基础(冯朝路等)

特征向量与矩阵分析

有右逆行满秩,左逆列满秩

MDS

保持变换前后空间内距离保持不变https://0809zheng.github.io/2021/07/28/mds.html

def MDS (data, k ): d, N = data.shape D = np.zeros([N, N]) for i in range (N): for j in range (N): D[i, j] = np.sqrt(np.sum ((data[:,i]-data[:,j])**2 )) T1 = np.sum (D**2 , axis=0 , keepdims=True )/N T2 = np.sum (D**2 , axis=1 , keepdims=True )/N T3 = np.sum (D**2 , keepdims=True )/N**2 B = (T1+T2-T3-D**2 )/2 eig_values, eig_vectors = np.linalg.eig(B) index = np.argsort(-eig_values)[:k] MDS_values = eig_values[index] MDS_vectors = eig_vectors[:, index] reduced_data = np.diagflat(MDS_values**0.5 ).dot(MDS_vectors.T) return reduced_data

stepB = − 1 2 H D 2 H where H = I − 1 N i i T B=-\frac{1}{2}HD^2H\text{ where }H=I-\frac{1}{N}ii^T B = − 2 1 H D 2 H where H = I − N 1 i i T

dimension reduction(PCA)

对独立同分布向量(假设均值为0向量)构成的矩阵,其协方差矩阵为 S = 1 N ∑ n = 1 N x n x n T S=\frac{1}{N}\mathop{\sum}\limits_{n=1}\limits^{N}x_nx_n^T S = N 1 n = 1 ∑ N x n x n T z n = B T x n ∈ R M z_n=B^Tx_n\in \mathbb{R}^M z n = B T x n ∈ R M B ∈ R D × M B\in \mathbb{R}^{D\times M} B ∈ R D × M

最大方差视角 (Maximum Variance Perspective)

如果我们将数据包含的信息视为它“填充空间”的程度,就可以通过观察数据的分散程度来判断信息量的大小,即方差 (Variance)。

假设数据已经过中心化处理(均值为0),第一主成分方向 b 1 b_1 b 1 V 1 V_1 V 1

V 1 = 1 N ∑ n = 1 N z 1 n 2 = b 1 T ( 1 N ∑ n = 1 N x n x n T ) b 1 V_1 = \frac{1}{N} \sum_{n=1}^{N} z_{1n}^2 = b_1^T \left( \frac{1}{N} \sum_{n=1}^{N} x_n x_n^T \right) b_1

V 1 = N 1 n = 1 ∑ N z 1 n 2 = b 1 T ( N 1 n = 1 ∑ N x n x n T ) b 1

约束条件: 注意到单纯增加 b 1 b_1 b 1 ∥ b 1 ∥ 2 = 1 \|b_1\|_2 = 1 ∥ b 1 ∥ 2 = 1 b 1 T b 1 = 1 b_1^T b_1 = 1 b 1 T b 1 = 1

这是一个受限优化问题。通过拉格朗日乘数法可以证明:b 1 b_1 b 1 V 1 V_1 V 1

为了研究第一主成分的影响,我们可以将坐标投影回原空间:

x ~ 1 n = b 1 z 1 n = b 1 b 1 T x 1 n \tilde{x}_{1n} = b_1 z_{1n} = b_1 b_1^T x_{1n}

x ~ 1 n = b 1 z 1 n = b 1 b 1 T x 1 n

Tips:尽管投影结果是一个 D D D

寻找后续主成分

假设我们已经找到了前 m − 1 m-1 m − 1 m m m m − 1 m-1 m − 1

X ^ : = X − ∑ i = 1 m − 1 b i b i T X \hat{X} := X - \sum_{i=1}^{m-1} b_i b_i^T X

X ^ := X − i = 1 ∑ m − 1 b i b i T X

注意: 为了公式表达方便,此处设定数据矩阵 X X X D × N D \times N D × N N × D N \times D N × D

相似性度量

以下均研究两个特征向量之间的相似性

闵氏距离(minkowski distance):d ( x , y ) = ( ∑ i = 1 n ∣ x i − y i ∣ p ) 1 p d(x,y)=(\sum_{i=1}^{n}|x_i-y_i|^p)^{\frac{1}{p}} d ( x , y ) = ( ∑ i = 1 n ∣ x i − y i ∣ p ) p 1

曼哈顿距离(manhattan distance):

欧几里得距离(enclidean distance):

切比雪夫距离(chebyshev distance):p → ∞ p\rightarrow \infty p → ∞

马氏距离(Mahalanobis Distance):d ( x i , x j ) = ( x i − x j ) Σ − 1 ( x i − x j ) T where Σ = ( X − X ˉ ) ( X − X ˉ ) T d(x_i,x_j)=\sqrt{(x_i-x_j)\Sigma^{-1}(x_i-x_j)^T}\text{ where }\Sigma=(X-\bar{X})(X-\bar{X})^T d ( x i , x j ) = ( x i − x j ) Σ − 1 ( x i − x j ) T where Σ = ( X − X ˉ ) ( X − X ˉ ) T

余弦距离:d = 1 − x y T x x T y y T d=1-\frac{xy^T}{\sqrt{xx^T}\sqrt{yy^T}} d = 1 − x x T y y T x y T

汉明距离(hamming distance):d = ∑ i = 1 n s g n ( ∣ x i − y i ∣ ) d=\sum_{i=1}^n sgn(|x_i-y_i|) d = ∑ i = 1 n s g n ( ∣ x i − y i ∣ )

杰卡德距离(jaccard distance):s = 1 n ∑ i = 1 n ( 1 − s g n ( ∣ x i − y i ∣ ) ) s=\frac{1}{n}\sum_{i=1}^{n}(1-sgn(|x_i-y_i|)) s = n 1 ∑ i = 1 n ( 1 − s g n ( ∣ x i − y i ∣ ))

皮尔森相关系数(pearson correlation coefficient)(中心化的余弦相似度)s = ( x − x ˉ ) ( y − y ˉ ) ( x − x ˉ ) ( x − x ˉ ) T ( y − y ˉ ) ( y − y ˉ ) T s=\frac{(x-\bar{x})(y-\bar{y})}{\sqrt{(x-\bar{x})(x-\bar{x})^T}\sqrt{(y-\bar{y})(y-\bar{y})^T}} s = ( x − x ˉ ) ( x − x ˉ ) T ( y − y ˉ ) ( y − y ˉ ) T ( x − x ˉ ) ( y − y ˉ )

斯皮尔曼距离(spearman distance)r ( x i ) = j r(x_i)=j r ( x i ) = j

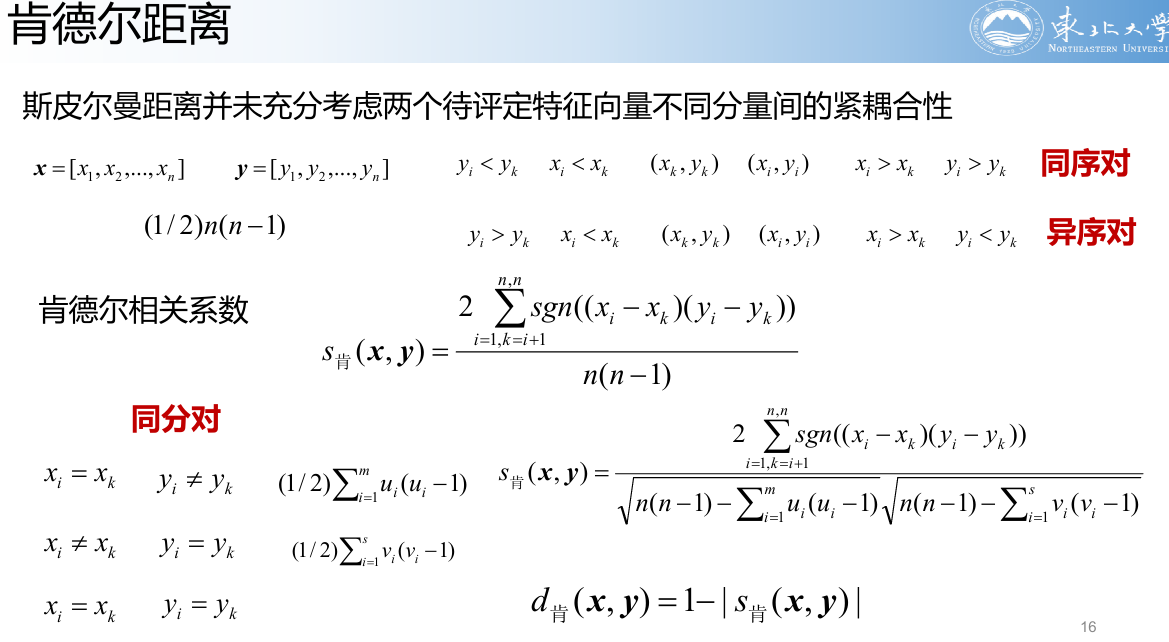

肯德尔距离(kendall distance)

函数与泛函分析

线性判别分析(LDA):寻找数据投影,使其类内散度(方差)最小,类间散度(均值差)最大

m a x ( m 1 − m 2 ) 2 s 1 2 + s 2 2 J f = w S b w T w S w w T = w ( σ 1 2 + σ 2 2 ) w T w ( μ 1 − μ 2 ) T ( μ 1 − μ 2 ) w T max\frac{(m_1-m_2)^2}{s_1^2+s_2^2}

J_f=\frac{wS_bw^T}{wS_ww^T}=\frac{w(\sigma_1^2+\sigma_2^2)w^T}{w(\mu_1-\mu_2)^T(\mu_1-\mu_2)w^T}

ma x s 1 2 + s 2 2 ( m 1 − m 2 ) 2 J f = w S w w T w S b w T = w ( μ 1 − μ 2 ) T ( μ 1 − μ 2 ) w T w ( σ 1 2 + σ 2 2 ) w T

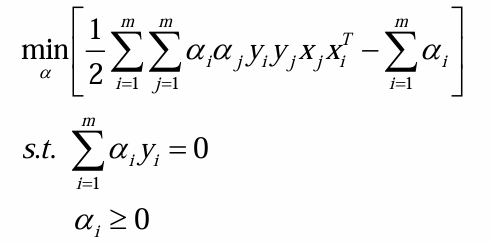

支持向量机(SVM):不只是将数据线性可分,并且要最大化间隔

S = ∣ w T x + b ∣ ∣ ∣ w ∣ ∣ { w T x + b ∣ ∣ w ∣ ∣ d ≥ 1 , y = 1 w T x + b ∣ ∣ w ∣ ∣ d ≤ − 1 , y = − 1 \begin{aligned}

S=\frac{|w^Tx+b|}{||w||}\\

\begin{cases}

\frac{w^Tx+b}{||w||d}\ge 1,y=1\\

\frac{w^Tx+b}{||w||d}\le -1,y=-1\\

\end{cases}

\end{aligned}

S = ∣∣ w ∣∣ ∣ w T x + b ∣ { ∣∣ w ∣∣ d w T x + b ≥ 1 , y = 1 ∣∣ w ∣∣ d w T x + b ≤ − 1 , y = − 1

y ( w T x + b ) − 1 + ξ ≥ 0 m a x ( 2 × y ( w T x + b ) ∣ ∣ w ∣ ∣ ) \begin{aligned}

y(w^Tx+b)-1+\xi \ge 0\\

max (2\times \frac{y(w^Tx+b)}{||w||})\\

\end{aligned}

y ( w T x + b ) − 1 + ξ ≥ 0 ma x ( 2 × ∣∣ w ∣∣ y ( w T x + b ) )

有一个松弛变量用于软化,对于支持向量,目标分子为1,优化问题变为最小化w的模长+松弛参数

集合与区间

θ x + ( 1 − θ ) y ∈ C for all x , y ∈ C \theta x+(1-\theta)y\in C\text{ for all }x,y\in C

θ x + ( 1 − θ ) y ∈ C for all x , y ∈ C

凸函数

f ( θ x + ( 1 − θ ) y ) ≤ θ f ( x ) + ( 1 − θ ) f ( y ) f(\theta x+(1-\theta)y)\le \theta f(x)+(1-\theta)f(y)

f ( θ x + ( 1 − θ ) y ) ≤ θ f ( x ) + ( 1 − θ ) f ( y )

凸集:对一个集合,其中任意两点的连线仍然在集合中的集合称为凸集

w s 1 T ≥ 0 , ∀ s 1 ∈ S 1 w s 2 T ≤ 0 , ∀ s 2 ∈ S 2 \begin{aligned}

ws_1^T\ge 0,\forall s_1\in S_1\\

ws_2^T\le 0,\forall s_2\in S_2

\end{aligned}

w s 1 T ≥ 0 , ∀ s 1 ∈ S 1 w s 2 T ≤ 0 , ∀ s 2 ∈ S 2

区间是具有特定属性的实数集合

区间的算术:对区间进行四则运算得到的区间就是元素四则运算得到的所有结果

凸函数与严格凸函数:严格凸函数就是不取等

f ( x 2 ) ≥ f ( x 1 ) + ∇ f ( x 1 ) ( x 2 − x 1 ) f(x_2)\ge f(x_1)+\nabla f(x_1)(x_2-x_1)

f ( x 2 ) ≥ f ( x 1 ) + ∇ f ( x 1 ) ( x 2 − x 1 )

二阶充要条件就是黑塞矩阵为半正定

曲率:取x0左右邻接点确定一个圆,邻接点接近x0即为密切圆,密切圆圆心轨迹称渐趋线,函数称为密切圆的圆心轨迹的渐伸线

κ ( x 0 ) = ∣ f ′ ′ ( x 0 ) ∣ ( 1 + f ′ ( x 0 ) 2 ) 3 2 \kappa(x_0)=\frac{|f^{\prime\prime}(x_0)|}{(1+f^{\prime}(x_0)^2)^{\frac{3}{2}}}

κ ( x 0 ) = ( 1 + f ′ ( x 0 ) 2 ) 2 3 ∣ f ′′ ( x 0 ) ∣

泛函分析

以函数为自变量的函数,称为泛函

函数内积

< f , g > = ∫ f ( x ) g ( x ) d x <f,g>=\int f(x)g(x)dx

< f , g >= ∫ f ( x ) g ( x ) d x

∫ K ( x , y ) ϕ ( y ) d y = λ ϕ ( x ) K ( x , y ) = ∑ i = 1 ∞ λ i ϕ i ( x ) ϕ i ( y ) \begin{aligned}

\int K(x,y)\phi(y)dy=\lambda \phi(x)\\

K(x,y)=\sum_{i=1}^{\infty}\lambda_i \phi_i(x)\phi_i(y)

\end{aligned}

∫ K ( x , y ) ϕ ( y ) d y = λ ϕ ( x ) K ( x , y ) = i = 1 ∑ ∞ λ i ϕ i ( x ) ϕ i ( y )

则称一元函数是二元函数的特征函数,对应系数即为特征值(存在无穷多的特征值和特征向量)

二元函数可视为无限维的矩阵

∫ ∫ f ( x ) K ( x , y ) f ( y ) d x d y ≥ 0 \int\int f(x)K(x,y)f(y)dxdy\ge 0

∫∫ f ( x ) K ( x , y ) f ( y ) d x d y ≥ 0

则称K为对称半正定

线性空间与线性映射

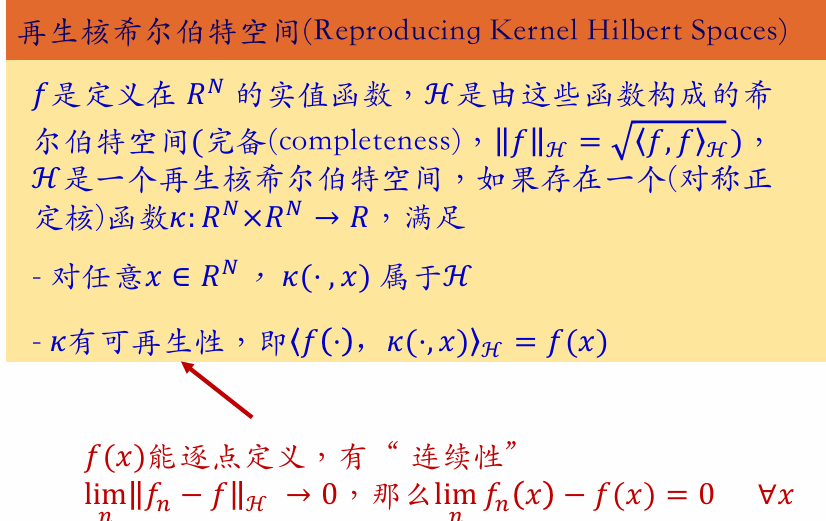

希尔伯特再生空间(RKHS)

K ( x , y ) = ∑ i = 1 ∞ λ i ϕ i ( x ) ϕ i ( y ) K ( x , : ) = [ λ i ϕ i ( x ) , . . . ] ( 基 ) < K ( x , : ) , k ( : , y ) > H = K ( x , y ) f = ∑ i = 1 ∞ a i ϕ i ∣ ∣ f ∣ ∣ o r i g i n 2 = ∫ ∣ f ( x ) ∣ 2 d x = ∑ i = 0 ∞ a i 2 ∣ ∣ f ∣ ∣ R K H S 2 = ∑ i = 0 ∞ a i 2 λ i < f , g > H = ∑ i = 1 ∞ a i b i λ i for function f ( t ) = ∑ a i ϕ i ( t ) and g ( t ) = ∑ b i ϕ i ( t ) \begin{aligned}

K(x,y)=\sum_{i=1}^{\infty}\lambda_i \phi_i(x)\phi_i(y)\\

K(x,:)=[\sqrt{\lambda_i}\phi_i(x),...](基)\\

<K(x,:),k(:,y)>_{\mathcal{H}}=K(x,y)\\

f=\sum_{i=1}^{\infty}a_i\phi_i\\

||f||^2_{origin}=\int |f(x)|^2dx=\sum_{i=0}^{\infty}a_i^2 \\

||f||^2_{RKHS}=\sum_{i=0}^{\infty}\frac{a_i^2}{\lambda_i}\\

<f,g>_{\mathcal{H}}=\sum_{i=1}^\infty \frac{a_ib_i}{\lambda_i}\text{ for function }f(t)=\sum a_i\phi_i (t) \text{ and }g(t)=\sum b_i \phi_i(t)

\end{aligned}

K ( x , y ) = i = 1 ∑ ∞ λ i ϕ i ( x ) ϕ i ( y ) K ( x , : ) = [ λ i ϕ i ( x ) , ... ] ( 基 ) < K ( x , : ) , k ( : , y ) > H = K ( x , y ) f = i = 1 ∑ ∞ a i ϕ i ∣∣ f ∣ ∣ or i g in 2 = ∫ ∣ f ( x ) ∣ 2 d x = i = 0 ∑ ∞ a i 2 ∣∣ f ∣ ∣ R K H S 2 = i = 0 ∑ ∞ λ i a i 2 < f , g > H = i = 1 ∑ ∞ λ i a i b i for function f ( t ) = ∑ a i ϕ i ( t ) and g ( t ) = ∑ b i ϕ i ( t )

度量空间(matric space)

度量空间:集合配上一个距离函数(非负性,对称性,三角不等式)

赋范线性空间:集合配上一个范数函数,可以很自然转化为度量空间

巴纳赫空间(banach space):完备赋范向量空间

完备:空间任意向量的柯西序列收敛至良定义的空间内部

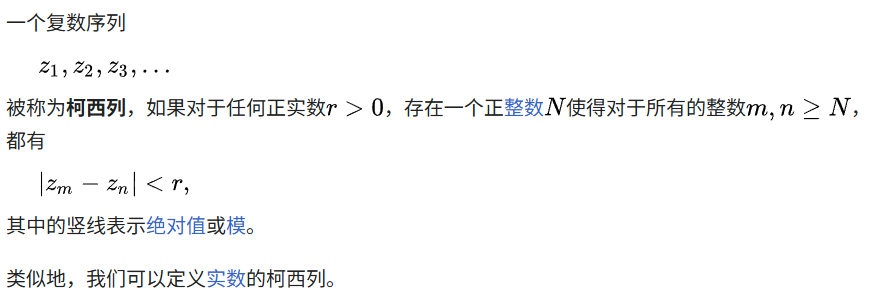

柯西序列:

比如有理数轴就不符合定义:有理数组成的柯西序列收敛至无理数

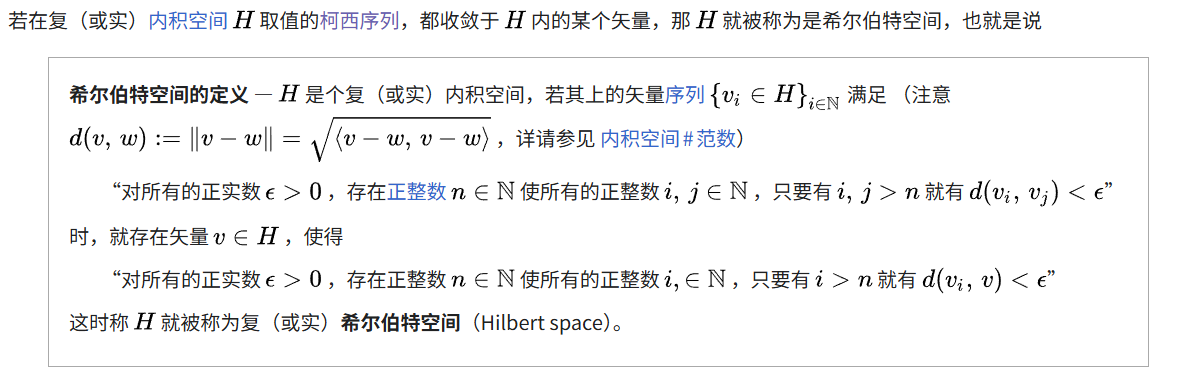

希尔伯特空间(Hilbert Spaces):完备的内积空间(带有内积的完备矢量空间)

∣ ∣ u + v ∣ ∣ 2 + ∣ ∣ u − v ∣ ∣ 2 = 2 ( ∣ ∣ u ∣ ∣ 2 + ∣ ∣ v ∣ ∣ 2 ) ||u+v||^2+||u-v||^2=2(||u||^2+||v||^2)

∣∣ u + v ∣ ∣ 2 + ∣∣ u − v ∣ ∣ 2 = 2 ( ∣∣ u ∣ ∣ 2 + ∣∣ v ∣ ∣ 2 )

线性算子(linear operator)

线性算子

线性泛函

有界性与连续性(赋范空间)

T : X → Y , ∃ M , ∣ ∣ T x ∣ ∣ ≤ M ∣ ∣ x ∣ ∣ ∣ ∣ T ∣ ∣ = s u p ∣ ∣ x ∣ ∣ = 1 ∣ ∣ T x ∣ ∣ \begin{aligned}

T:X\rightarrow Y,\exists M,||Tx||\le M||x||\\

||T||=sup_{||x||=1}||Tx||

\end{aligned}

T : X → Y , ∃ M , ∣∣ T x ∣∣ ≤ M ∣∣ x ∣∣ ∣∣ T ∣∣ = s u p ∣∣ x ∣∣ = 1 ∣∣ T x ∣∣

对偶空间(dual space)

对偶空间就是在原始向量空间上的所有表现良好(即连续)的线性泛函:提供了从外部研究空间的方法

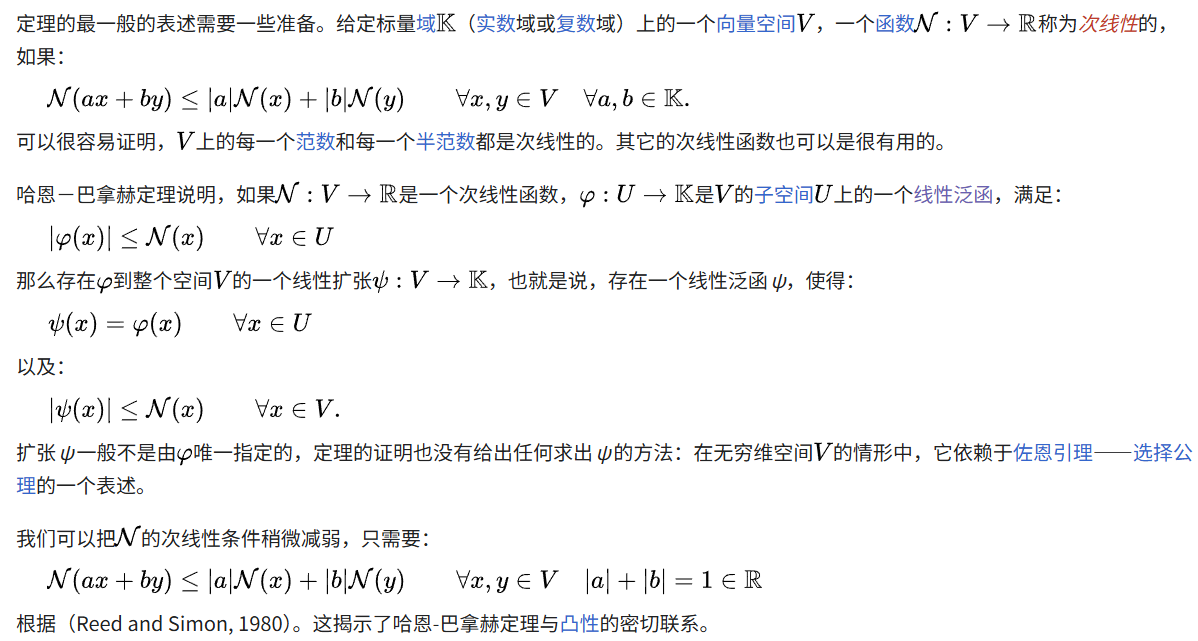

hahn-banach定理

1.对空间中两个不相同的点,一定存在一个有界线性泛函在两点的取值不同

2.若在X子空间上定义了一个有界线性泛函,则我们可以将其延拓到整个空间并保持范数不变

设n维线性空间的一组基为 ϵ i , f i ( ϵ j ) = 1 ( w h e n i = j ) \epsilon_i,f_i(\epsilon_j)=1(when\text{ }i=j) ϵ i , f i ( ϵ j ) = 1 ( w h e n i = j )

α = ∑ i = 1 n x i ϵ i x i = f i ( α ) \begin{aligned}

\alpha=\sum_{i=1}^{n}x_i\epsilon_i\\

x_i=f_i(\alpha)

\end{aligned}

α = i = 1 ∑ n x i ϵ i x i = f i ( α )

Riesz 表示定理 (Riesz Representation Theorem)

f ( x ) = < x , y f > f(x)=<x,y_f>

f ( x ) =< x , y f >

,并且泛函的范数等于那个向量的范数,这意味着任何一种抽象的测量都可以对应为与一个模板做对应

伴随算子(adjoint operator)

< A x , y > = < x , A ∗ y > <Ax,y>=<x,A^*y>

< A x , y >=< x , A ∗ y >

两者范数相等

谱理论(spectual theory)

核心直觉:什么是“谱” (The Spectrum)?

在线性代数中,我们研究特征值 λ \lambda λ

从方程出发 :考虑算子方程 ( T − λ I ) x = y (T - \lambda I)x = y ( T − λ I ) x = y

在有限维中,这个方程要么有唯一解(λ \lambda λ λ \lambda λ

在无穷维中,情况变得复杂。即便 λ \lambda λ x = ( T − λ I ) − 1 y x = (T - \lambda I)^{-1}y x = ( T − λ I ) − 1 y 无界、不连续或定义域不全 的情况。

定义 :使 ( T − λ I ) (T - \lambda I) ( T − λ I ) λ \lambda λ 谱 σ ( T ) \sigma(T) σ ( T ) 。AI 视角 :谱描述了一个模型(算子)的稳定性 和能量分布 。例如,如果一个神经网络层的算子谱半径(最大的特征值模长)大于 1,信号在传递时就会呈指数级放大,导致梯度爆炸。

紧算子 (Compact Operators):无穷维中的“有限维化”

这是理解谱理论在 AI 中应用的关键。

定义 :如果一个算子能把空间中的有界集 (比如单位球)映射成一个相对紧集 (其闭包每个序列都有收敛子列),它就是紧算子。形象理解 :“平滑效应” 。

紧算子就像是一个“低通滤波器”。它能把杂乱无章、无限维度的输入,压缩成一个有秩序、主要维度清晰的输出。

例子 :神经网络中常见的积分变换 、高斯模糊 。

谱的奇迹 :紧算子的谱非常简单。

几乎全是特征值 :除了 0 以外,谱里的每一个点都是实打实的特征值。可数性 :特征值是一串离散的数字,不会填满一个区间。趋向于 0 :如果特征值有无穷多个,它们必须排队走向 0。

AI 意义 :这解释了为什么主成分分析 (PCA) 或自编码器 (Autoencoder) 能够工作。因为数据的主要信息集中在少数几个大的特征值对应的方向上,而无穷无尽的微小维度(噪声)都随着特征值趋向于 0 而消失了。

自伴算子 (Self-adjoint):无穷维的“对称性”

定义 :满足 ⟨ T f , g ⟩ = ⟨ f , T g ⟩ \langle Tf, g \rangle = \langle f, Tg \rangle ⟨ T f , g ⟩ = ⟨ f , T g ⟩ 形象理解 :它是**“物理上可观测”**的。

两大特性 :

谱是实的 :特征值永远是实数,没有虚部。这保证了模型测量的结果是有物理意义的数值。正交性 :不同特征值对应的特征函数(特征向量)是完全垂直的。

紧自伴算子的谱定理:完美的终极分解

当一个算子既是紧 的又是自伴 的时,我们得到了泛函分析中最美丽的结论:谱定理 。

结论 :你可以找到一组标准正交基 { e n } \{e_n\} { e n } T T T 分解公式 :T f = ∑ λ n ⟨ f , e n ⟩ e n Tf = \sum \lambda_n \langle f, e_n \rangle e_n T f = ∑ λ n ⟨ f , e n ⟩ e n 这意味着什么?

任何复杂的输入 f f f e n e_n e n

算子 T T T λ n \lambda_n λ n

谱理论在 AI 中的深度应用实例

(1) 核方法中的 Mercer 定理 (Mercer’s Theorem)

如果我们定义一个核函数 K ( x , y ) K(x, y) K ( x , y )

Mercer 定理 说:这个核可以分解为 K ( x , y ) = ∑ λ n ϕ n ( x ) ϕ n ( y ) K(x, y) = \sum \lambda_n \phi_n(x) \phi_n(y) K ( x , y ) = ∑ λ n ϕ n ( x ) ϕ n ( y ) 这就是为什么我们可以把复杂的非线性映射,转化为在希尔伯特空间中的线性操作。

(2) 扩散模型 (Diffusion Models) 与拉普拉斯谱

这个过程由拉普拉斯-贝尔特拉米算子 (Laplace-Beltrami Operator) 支配。

该算子是自伴的,它的特征函数(谱)对应于图像的不同频率 。

谱理论解释 :扩散过程本质上是按照谱的顺序(特征值的大小),先抹除高频噪声(对应小的特征值),保留低频结构(对应大的特征值)。生成过程则是这个谱演化的逆过程。

(3) 谱归一化 (Spectral Normalization)W W W 谱范数 (最大特征值)等于 1。

原理 :根据谱理论,这保证了该算子是一个 利普希茨连续 (Lipschitz Continuous) 映射,防止了模型在更新时梯度剧烈抖动,确保了算子的“有界性”。

条件概率和贝叶斯

gamma函数可以认为是阶乘在实数域上的拓展

f ( x ) = λ α x α − 1 e − λ x Γ ( α ) , x > 0 f(x)=\frac{\lambda^{\alpha}x^{\alpha -1}e^{-\lambda x}}{\Gamma(\alpha)},x>0

f ( x ) = Γ ( α ) λ α x α − 1 e − λ x , x > 0

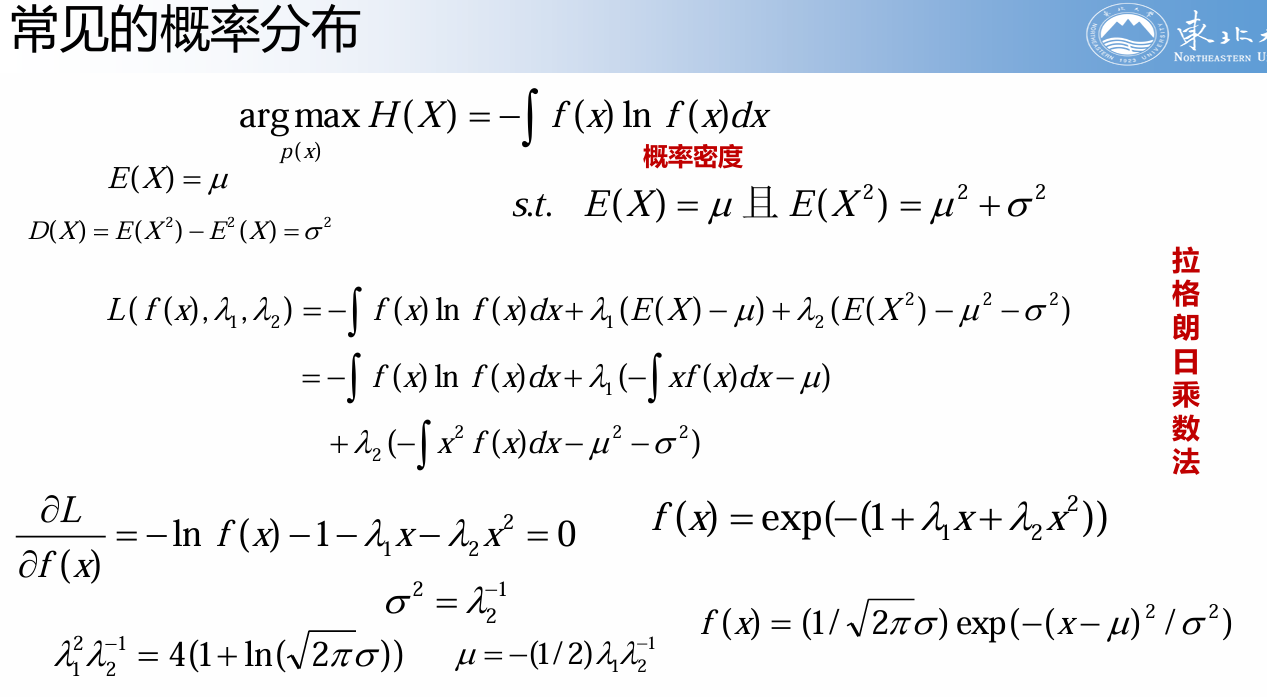

熵最大原理:正态分布是确定均值和方差之后熵最大的分布

P ( e ) = ∫ R 1 P ( w 2 ∣ x ) f ( x ) d x + ∫ R 2 P ( w 1 ∣ x ) f ( x ) d x P(e)=\int_{R_1}P(w_2|x)f(x)dx+\int_{R_2}P(w_1|x)f(x)dx

P ( e ) = ∫ R 1 P ( w 2 ∣ x ) f ( x ) d x + ∫ R 2 P ( w 1 ∣ x ) f ( x ) d x

求其argmin的过程即定义了最小错误率贝叶斯决策(错误率最小其实等价于选后验概率最大)

a r g m a x i ( P ( w i ∣ x ) ) argmax_i(P(w_i|x))

a r g ma x i ( P ( w i ∣ x ))

多分类决策就是将特征空间分割为更多的区域,为减少计算量通常采用错误率=1-平均正确率

最小风险贝叶斯

R ( α ( x ) ∣ x ) = ∑ i = 1 C λ ( α ( x ) , w i ) P ( w i ∣ x ) a r g m i n α R ( α ) = a r g m i n α ( ∫ R ( α ( x ) ∣ x ) f ( x ) d x ) \begin{aligned}

R(\alpha(x)|x)=\sum_{i=1}^{C}\lambda(\alpha(x),w_i)P(w_i|x)\\

argmin_{\alpha} R(\alpha)=argmin_{\alpha}(\int R(\alpha(x)|x)f(x)dx)

\end{aligned}

R ( α ( x ) ∣ x ) = i = 1 ∑ C λ ( α ( x ) , w i ) P ( w i ∣ x ) a r g mi n α R ( α ) = a r g mi n α ( ∫ R ( α ( x ) ∣ x ) f ( x ) d x )

朴素贝叶斯分类

P ( x ∣ y k ) = ∏ i = 1 d P ( x i ∣ y k ) P(x|y_k)=\prod_{i=1}^dP(x_i|y_k)

P ( x ∣ y k ) = i = 1 ∏ d P ( x i ∣ y k )

可使用训练集中的各类样本出现的比例估计类先验概率和类条件概率

P ( x i ∣ y k ) = n i + m p m + n P(x_i|y_k)=\frac{n_i+mp}{m+n}

P ( x i ∣ y k ) = m + n n i + m p

a r g m i n w ^ ( w ^ X − y ) ( w ^ X − y ) T argmin_{\hat{w}}(\hat{w}X-y)(\hat{w}X-y)^T

a r g mi n w ^ ( w ^ X − y ) ( w ^ X − y ) T

若X与自身转置的乘积为正定则有唯一解

最大似然估计

最大后验概率估计:最大似然估计是先验为均匀分布的最大后验估计

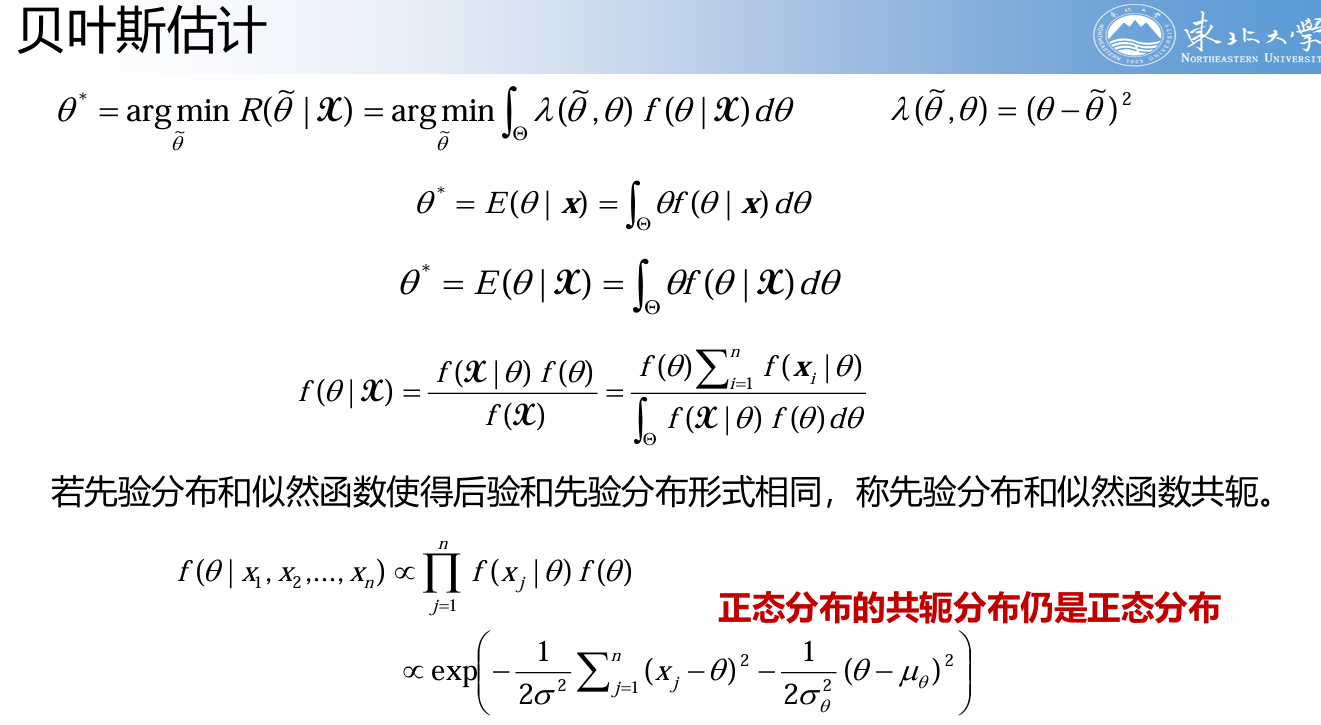

贝叶斯估计

信息论与熵

特征的选择和抽取:其实就是一种压缩编码

特征选择

G ( B ) = E n t ( D ) − ∑ i = 1 v ∣ D i ∣ ∣ D ∣ E n t ( D i ) G(B)=Ent(D)-\sum_{i=1}^v\frac{|D_i|}{|D|}Ent(D_i)

G ( B ) = E n t ( D ) − i = 1 ∑ v ∣ D ∣ ∣ D i ∣ E n t ( D i )

稀疏编码

m i n ∑ i = 1 m ( ∣ ∣ x i − y i B ∣ ∣ 2 2 + λ ∣ ∣ y i ∣ ∣ 1 ) min\sum_{i=1}^m(||x_i-y_iB||_2^2+\lambda||y_i||_1)

min i = 1 ∑ m ( ∣∣ x i − y i B ∣ ∣ 2 2 + λ ∣∣ y i ∣ ∣ 1 )

其中x为原向量,y为压缩后的

y = x Φ x = s Ψ y = s Ψ Φ \begin{aligned}

y=x\Phi\\

x=s\Psi\\

y=s\Psi\Phi

\end{aligned}

y = x Φ x = s Ψ y = s ΨΦ

变换将x变为低维向量y,可以选择恰当的基向量使s为稀疏的,这样可以解

决策编码和决策解码

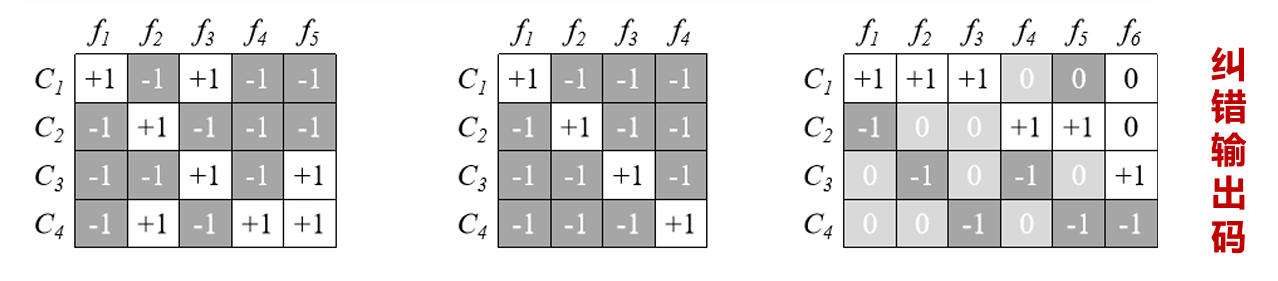

多分类学习的基本思路是拆分法

纠错输出码(error correcting output codes,ECOC)

其决策解码:

自编码

自编码器由一个编码器和一个解码器构成,编码器将原始映射为隐藏表示,解码器从原始映射重构

a r g m i n g , f L ( x , g ( f ( x ) ) ) ( 欠完备 ) a r g m i n g , f ( L ( x , g ( f ( x ) ) ) + R ( f ( x ) ) ) ( 稀疏自编码 , R 常取 f ( x ) 的范数 ) a r g m i n g , f ( L ( x , g ( f ( x ) ) ) + R ( f ( x ) , x ) ) ( 收缩自编码 , 比如取梯度范数 , 要求对扰动鲁棒 ) \begin{aligned}

arg min_{g,f} L(x,g(f(x)))&(欠完备)\\

arg min_{g,f} (L(x,g(f(x)))+R(f(x)))&(稀疏自编码,R常取f(x)的范数)\\

arg min_{g,f} (L(x,g(f(x)))+R(f(x),x))&(收缩自编码,比如取梯度范数,要求对扰动鲁棒)\\

\end{aligned}

a r g mi n g , f L ( x , g ( f ( x ))) a r g mi n g , f ( L ( x , g ( f ( x ))) + R ( f ( x ))) a r g mi n g , f ( L ( x , g ( f ( x ))) + R ( f ( x ) , x )) ( 欠完备 ) ( 稀疏自编码 , R 常取 f ( x ) 的范数 ) ( 收缩自编码 , 比如取梯度范数 , 要求对扰动鲁棒 )

熵

度量不确定性

E n t ( x ) = − ∫ f ( x ) l o g a ( f ( x ) ) d x Ent(x)=-\int f(x)log_a(f(x))dx

E n t ( x ) = − ∫ f ( x ) l o g a ( f ( x )) d x

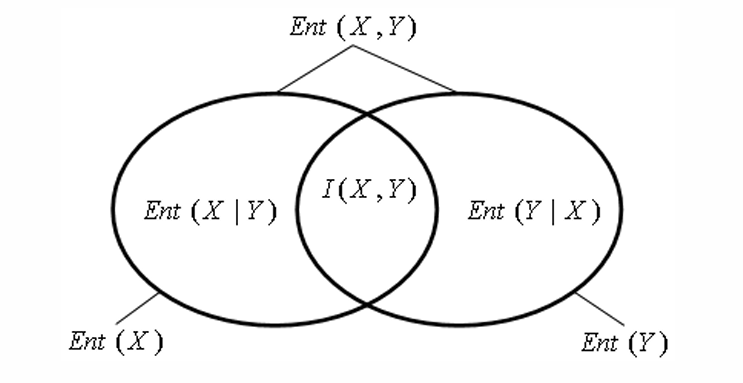

联合熵

E n t ( X , Y ) = − ∫ ∫ f ( x , y ) l o g a ( f ( x , y ) ) d x d y Ent(X,Y)=-\int\int f(x,y)log_a(f(x,y))dxdy

E n t ( X , Y ) = − ∫∫ f ( x , y ) l o g a ( f ( x , y )) d x d y

E n t ( X ∣ Y ) = − ∫ ∫ f ( x , y ) l o g a ( f ( x ∣ y ) ) d x d y Ent(X|Y)=-\int\int f(x,y)log_a(f(x|y))dxdy

E n t ( X ∣ Y ) = − ∫∫ f ( x , y ) l o g a ( f ( x ∣ y )) d x d y

E n t ( f 0 , f 1 ) = − ∫ f 0 ( x ) l o g a ( f 1 ( x ) ) d x D K L ( f 0 ∣ ∣ f 1 ) = ∫ f 0 ( x ) l o g a ( f 0 ( x ) f 1 ( x ) ) d x = E n t ( f 0 , f 1 ) − E n t ( f 0 ) \begin{aligned}

Ent(f_0,f_1)=-\int f_0(x)log_a(f_1(x))dx\\

D_{KL}(f_0||f_1)=\int f_0(x)log_a(\frac{f_0(x)}{f_1(x)})dx=Ent(f_0,f_1)-Ent(f_0)

\end{aligned}

E n t ( f 0 , f 1 ) = − ∫ f 0 ( x ) l o g a ( f 1 ( x )) d x D K L ( f 0 ∣∣ f 1 ) = ∫ f 0 ( x ) l o g a ( f 1 ( x ) f 0 ( x ) ) d x = E n t ( f 0 , f 1 ) − E n t ( f 0 )

互信息

给定提示信息X,Y的不确定性的减少量

I ( Y ; X ) = E n t ( Y ) − E n t ( Y ∣ x ) = D K L ( f ( x , y ) ∣ ∣ f ( x ) f ( y ) ) g ( x , y ) = l o g a ( f ( x , y ) f ( x ) f ( y ) ) P M I ( 点互信息 ) \begin{aligned}

I(Y;X)=Ent(Y)-Ent(Y|x)=D_{KL}(f(x,y)||f(x)f(y))\\

g(x,y)=log_a(\frac{f(x,y)}{f(x)f(y)})PMI(点互信息)

\end{aligned}

I ( Y ; X ) = E n t ( Y ) − E n t ( Y ∣ x ) = D K L ( f ( x , y ) ∣∣ f ( x ) f ( y )) g ( x , y ) = l o g a ( f ( x ) f ( y ) f ( x , y ) ) P M I ( 点互信息 )

线性分析和卷积

卷积

卷积具有交换,分配,结合律

F ( f ( t ) ∗ g ( t ) ) = F ( w ) G ( w ) g ( x ) = ∫ f ( x − τ ) h ( τ ) d τ convolution F ( w ) = ∫ f ( t ) e − i ω t d t fourier transform f ∗ g = ∑ τ ∑ η f ( x − τ , y − η ) g ( τ , η ) 2d conv g ( x ) = r ( ∪ τ = − b + b f ( x − τ ) ) pooling \begin{aligned}

F(f(t)*g(t))=F(w)G(w)\\

g(x)=\int f(x-\tau)h(\tau)d\tau \text{ convolution}\\

F(w)=\int f(t)e^{-i\omega t}dt \text{ fourier transform}\\

f*g=\sum_{\tau}\sum_{\eta}f(x-\tau,y-\eta)g(\tau,\eta)\text{ 2d conv }\\

g(x)=r(\cup_{\tau =-b}^{+b}f(x-\tau))\text{ pooling }

\end{aligned}

F ( f ( t ) ∗ g ( t )) = F ( w ) G ( w ) g ( x ) = ∫ f ( x − τ ) h ( τ ) d τ convolution F ( w ) = ∫ f ( t ) e − iω t d t fourier transform f ∗ g = τ ∑ η ∑ f ( x − τ , y − η ) g ( τ , η ) 2d conv g ( x ) = r ( ∪ τ = − b + b f ( x − τ )) pooling

边界填充:补零,扩展(填边界),镜像

步长:步长大于1又称空洞卷积

池化:下采样,但是并没有引入学习的参数的同时增大了卷积核的感受野

反卷积

一种上采样,本质上是补零后再卷积

o = ⌊ i + 2 p − k s ⌋ + 1 o ′ = s ( i ′ − 1 ) + a + k − 2 p where a = ( i + 2 p − k ) m o d S \begin{aligned}

o&=\lfloor\frac{i+2p-k}{s}\rfloor + 1\\

o^{\prime}&=s(i^{\prime}-1)+a+k-2p\text{ where }a=(i+2p-k)modS

\end{aligned}

o o ′ = ⌊ s i + 2 p − k ⌋ + 1 = s ( i ′ − 1 ) + a + k − 2 p where a = ( i + 2 p − k ) m o d S

矩阵视角

正则化和范数

硬正则化

x ′ = x − x m i n x m a x − x m i n x^{\prime}=\frac{x-x_{min}}{x_{max}-x_{min}}

x ′ = x ma x − x min x − x min

标准化:减均值除方差

early stop

权重共享(实际上是直接置0)

池化

随机失效(dropout,用掩码)

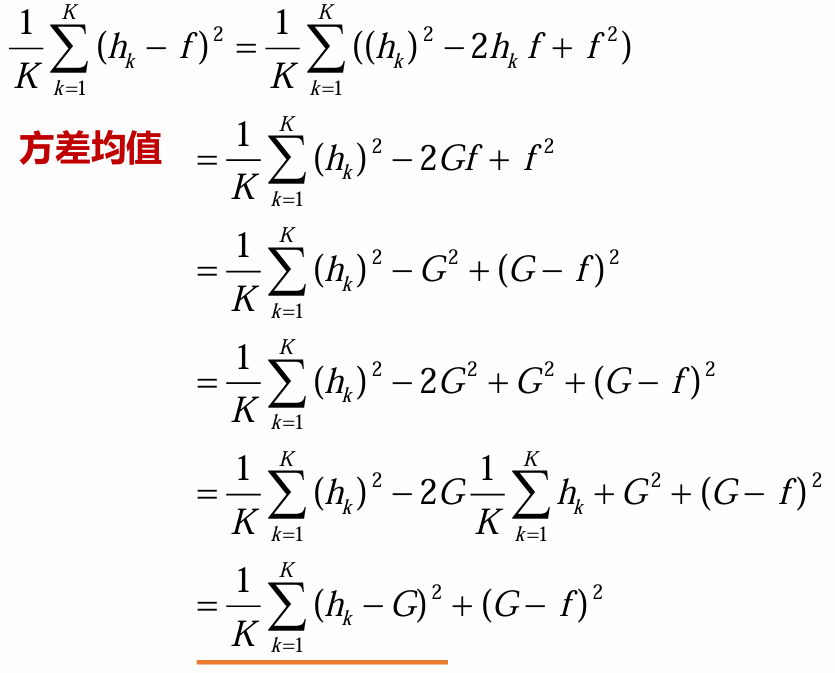

集成学习:h为其中一个模型,G为平均,f为真实目标

支持向量机

软正则化

(损失函数)

logistic loss(f为实际标签,h为其为预测标签)

L ( h , f ) = − f ( x ) l o g ( P ( h ( x ) = 1 ) ) − ( 1 − f ( x ) ) l o g ( P ( h ( x ) = 0 ) ) L(h,f)=-f(x)log(P(h(x)=1))-(1-f(x))log(P(h(x)=0))

L ( h , f ) = − f ( x ) l o g ( P ( h ( x ) = 1 )) − ( 1 − f ( x )) l o g ( P ( h ( x ) = 0 ))

L ( h ( x ) , f ( x ) ) = m a x ( 0 , 1 − f ( x ) h ( x ) ) L(h(x),f(x))=max(0,1-f(x)h(x))

L ( h ( x ) , f ( x )) = ma x ( 0 , 1 − f ( x ) h ( x ))

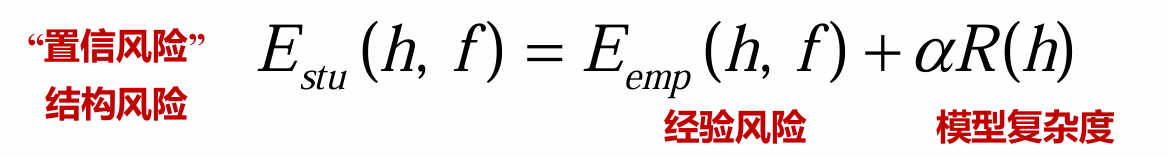

风险

范数

等价:对任意同一个向量的两种范数的比值始终具有常数下界和上界

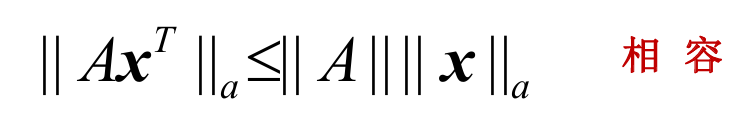

矩阵范数:

∣ ∣ W ∣ ∣ L u v = ∣ ∣ [ . . . , ∣ ∣ W : , i ∣ ∣ u , . . . ] ∣ ∣ v ||W||_{L_{uv}}=||[...,||W_{:,i}||_u,...]||_v

∣∣ W ∣ ∣ L uv = ∣∣ [ ... , ∣∣ W : , i ∣ ∣ u , ... ] ∣ ∣ v

其中1-范数指列模(列元素和的最大值),无穷-范数指行模,2-范数也叫谱范数,与自身转置乘积的最大特征值再开根

最优化

最优化理论与方法:拟牛顿法专题笔记

目标问题定义

数学模型 :min θ ∈ Θ f ( θ ) \min_{\theta \in \Theta} f(\theta) min θ ∈ Θ f ( θ ) g j ( θ ) = 0 g_j(\theta)=0 g j ( θ ) = 0 h i ( θ ) ≤ 0 h_i(\theta) \le 0 h i ( θ ) ≤ 0 最优性条件 :

一阶必要条件 (FONC) :驻点满足 ∇ f ( θ ∗ ) = 0 \nabla f(\theta^*) = 0 ∇ f ( θ ∗ ) = 0 第一充分条件 :在驻点去心邻域一阶导二阶充分条件 (SOSC) :在驻点处,Hessian 矩阵 H ( θ ) = ∇ 2 f ( θ ) H(\theta) = \nabla^2 f(\theta) H ( θ ) = ∇ 2 f ( θ ) 必须是正定的(H > 0 H > 0 H > 0

牛顿法 (Newton’s Method)

核心思想 :对 f ( θ ) f(\theta) f ( θ ) f ( θ + Δ θ ) ≈ f ( θ ) + ∇ f ( θ ) T Δ θ + 1 2 Δ θ T H ( θ ) Δ θ f(\theta+\Delta\theta) \approx f(\theta) + \nabla f(\theta)^T \Delta\theta + \frac{1}{2} \Delta\theta^T H(\theta) \Delta\theta f ( θ + Δ θ ) ≈ f ( θ ) + ∇ f ( θ ) T Δ θ + 2 1 Δ θ T H ( θ ) Δ θ 迭代公式 :θ k + 1 = θ k − η [ H ( θ k ) ] − 1 ∇ f ( θ k ) \theta_{k+1} = \theta_k - \eta[H(\theta_k)]^{-1} \nabla f(\theta_k) θ k + 1 = θ k − η [ H ( θ k ) ] − 1 ∇ f ( θ k ) 最速下降法: η k = a r g m i n η f ( θ k − η ∇ f ( θ k ) ) \eta_k=argmin_{\eta}f(\theta_k-\eta\nabla f(\theta_k)) η k = a r g mi n η f ( θ k − η ∇ f ( θ k ))

优缺点 :

优点 :具有二阶收敛速度。缺点 :每一轮迭代都需要计算 H H H n 2 n^2 n 2 O ( n 3 ) O(n^3) O ( n 3 )

第二部分:拟牛顿法 (Quasi-Newton) 核心思想

基本初衷H H H B k ≈ H B_k \approx H B k ≈ H G k ≈ H − 1 G_k \approx H^{-1} G k ≈ H − 1

拟牛顿方程 (Secant Equation)s k s_k s k y k y_k y k

s k = θ k + 1 − θ k s_k = \theta_{k+1} - \theta_k s k = θ k + 1 − θ k y k = ∇ f ( θ k + 1 ) − ∇ f ( θ k ) y_k = \nabla f(\theta_{k+1}) - \nabla f(\theta_k) y k = ∇ f ( θ k + 1 ) − ∇ f ( θ k ) 方程 :y k ≈ H k + 1 s k y_k \approx H_{k+1} s_k y k ≈ H k + 1 s k ⇒ \Rightarrow ⇒ B k + 1 s k = y k B_{k+1} s_k = y_k B k + 1 s k = y k s k = G k + 1 y k s_k = G_{k+1} y_k s k = G k + 1 y k

第三部分:数学引擎——Sherman-Morrison 公式它是将“矩阵更新”转化为“逆矩阵更新”的桥梁。

秩-1 修正 (SR1 - Symmetric Rank 1)

公式 :G k + 1 = G k + ( s k − G k y k ) ( s k − G k y k ) T y k T ( s k − G k y k ) G_{k+1} = G_k + \frac{(s_k - G_k y_k)(s_k - G_k y_k)^T}{y_k^T (s_k - G_k y_k)} G k + 1 = G k + y k T ( s k − G k y k ) ( s k − G k y k ) ( s k − G k y k ) T 评价 :形式简单,但不能保证正定性 ,容易由于分母趋近于 0 导致算法不稳定。推导 :G k + 1 = G k + u T v G_{k+1}=G_k+u^Tv G k + 1 = G k + u T v

秩-2 修正:DFP 与 BFGS (对偶双子星)

G k + 1 = G k + s k T s k y k s k T − G k y k T y k G k y k G k y k T G_{k+1}=G_k+\frac{s_k^Ts_k}{y_ks_k^T}-\frac{G_ky_k^Ty^kG_k}{y_kG_ky_k^T}

G k + 1 = G k + y k s k T s k T s k − y k G k y k T G k y k T y k G k

推导:s k = y k ( G k + α u T u + β v T v ) s_k=y_k(G_k+\alpha u^Tu+\beta v^Tv) s k = y k ( G k + α u T u + β v T v )

特性

DFP 算法

BFGS 算法

出发点 直接近似 Hessian 的逆 G G G

先近似 Hessian B B B

满足方程 G k + 1 y k = s k G_{k+1} y_k = s_k G k + 1 y k = s k B k + 1 s k = y k B_{k+1} s_k = y_k B k + 1 s k = y k

对偶关系 G ↔ B , s ↔ y G \leftrightarrow B, s \leftrightarrow y G ↔ B , s ↔ y 与 DFP 完全对称

稳定性 容易受到线搜索精度的影响

数值稳定性极佳 (业界主流)

第一步 (Hessian 近似) :先推导出 B k + 1 B_{k+1} B k + 1 第二步 (求逆应用) :利用 Sherman-Morrison 公式 (或者更通用的 Woodbury 公式),将 B B B G G G 终极公式 (BFGS 逆公式) :G k + 1 = G k + ( 1 + y k T G k y k s k T y k ) s k s k T y k T s k − G k y k s k T + s k y k T G k s k T y k G_{k+1} = G_k + \left(1 + \frac{y_k^T G_k y_k}{s_k^T y_k}\right) \frac{s_k s_k^T}{y_k^T s_k} - \frac{G_k y_k s_k^T + s_k y_k^T G_k}{s_k^T y_k}

G k + 1 = G k + ( 1 + s k T y k y k T G k y k ) y k T s k s k s k T − s k T y k G k y k s k T + s k y k T G k

该公式保证了只要初始 G 0 G_0 G 0 s k T y k > 0 s_k^T y_k > 0 s k T y k > 0 G k G_k G k

牛顿法快但贵 ,拟牛顿法通过秩修正 实现快且省 。拟牛顿法的数学核心是满足拟牛顿方程 。

BFGS 是 DFP 的对偶 ,因为其数值稳定性更好,成为了实际应用(如 Python 的 scipy.optimize)中的默认选择。正定性 是保证算法收敛到极小值(而非极大值或鞍点)的关键,BFGS 能够很好地维持这一性质。

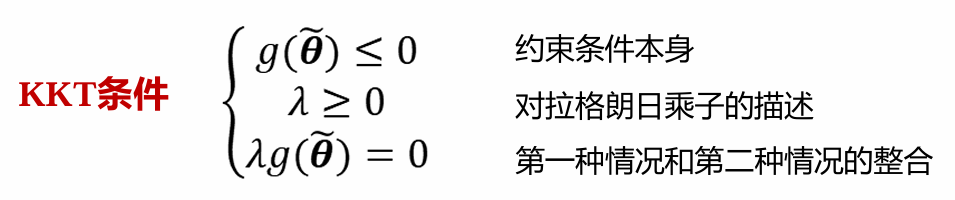

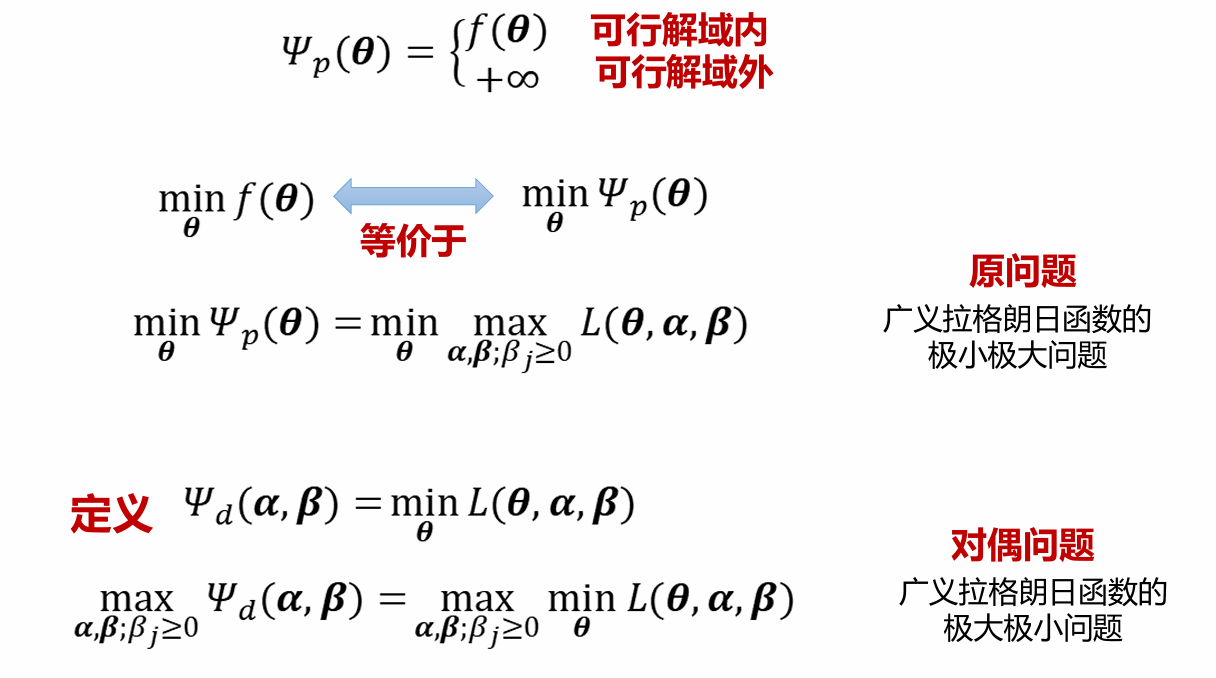

约束优化

KKT条件:其实是对最优解的约束(其中g表示不等式约束,h表示等式约束)

e.g:对支持向量机的优化可以转化为一个二次规划问题

( ∑ i a i ) ( ∑ j b j ) = ∑ i ∑ j a i b j (\sum_i a_i)(\sum_j b_j)=\sum_i \sum_j a_ib_j

( i ∑ a i ) ( j ∑ b j ) = i ∑ j ∑ a i b j

核函数映射

待识别对象线性可分:可被低一维的超平面分割

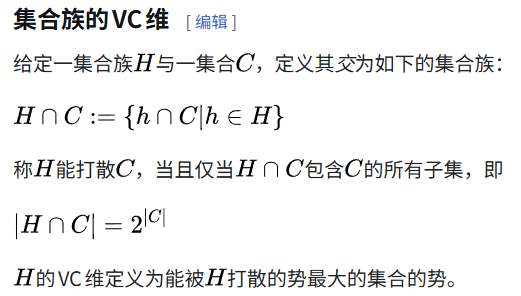

cover and mercer定理

C ( m , n ) = C ( m − 1 , n ) + C ( m − 1 , n − 1 ) C ( m , n ) = 2 ∑ i = 0 n − 1 ( m − 1 i ) ways m points can be divided in n-dimensional \begin{aligned}

C(m,n)&=C(m-1,n)+C(m-1,n-1)\\

C(m,n)&=2\sum_{i=0}^{n-1}\binom{m-1}{i}\text{ ways m points can be divided in n-dimensional }

\end{aligned}

C ( m , n ) C ( m , n ) = C ( m − 1 , n ) + C ( m − 1 , n − 1 ) = 2 i = 0 ∑ n − 1 ( i m − 1 ) ways m points can be divided in n-dimensional

待识别对象个数m确定的时候,其特征向量维度n越大,越可能线性可分

κ ( x i , x j ) = g ( x i ) κ 1 ( x i , x j ) g ( x j ) \kappa(x_i,x_j)=g(x_i)\kappa_1(x_i,x_j)g(x_j)

κ ( x i , x j ) = g ( x i ) κ 1 ( x i , x j ) g ( x j )

也是核函数

常见的核函数

多项式核

κ ( x , y ) = ( < x , y > + c ) q \kappa(x,y)=(<x,y>+c)^q

κ ( x , y ) = ( < x , y > + c ) q

齐次有序单项式向量空间

C d ( x ) = [ x k 1 x k 2 . . . x k d ∣ k 1 , k 2 , . . . k d ∈ 1 , 2.. n ] C_d(x)=[x_{k_1}x_{k_2}...x_{k_d}|k_1,k_2,...k_d \in {1,2..n}]

C d ( x ) = [ x k 1 x k 2 ... x k d ∣ k 1 , k 2 , ... k d ∈ 1 , 2.. n ]

两个d阶齐次有序单项式组成的向量的内积等于原向量内积的d次方

< D d ( x ) , D d ( y ) > = ( < x , y > + 1 ) d <D_d(x),D_d(y)>=(<x,y>+1)^d

< D d ( x ) , D d ( y ) >= ( < x , y > + 1 ) d

齐次无序单项式向量空间

对多项式核:c为0退化为齐次,q为0退化为线性核,均为0就是核映射的幺元

径向基核

也叫RBF(radical basis function):因变量仅依赖自变量到原点距离的

高斯核函数

κ ( x , y ) = e x p ( − ∣ ∣ x − y ∣ ∣ 2 2 σ 2 ) \kappa(x,y)=exp(- \frac{||x-y||^2}{2\sigma^2})

κ ( x , y ) = e x p ( − 2 σ 2 ∣∣ x − y ∣ ∣ 2 )

理论上能任意线性可分,但是复杂,容易过拟合

κ ( x , y ) = e x p ( − ∣ ∣ x − y ∣ ∣ 2 σ 2 ) \kappa(x,y)=exp(- \frac{||x-y||}{2\sigma^2})

κ ( x , y ) = e x p ( − 2 σ 2 ∣∣ x − y ∣∣ )

sigmoid核

也叫多层感知器核,注意区分sigmoid激活函数

κ ( x , y ) = t a n h ( β x y T + r ) \kappa(x,y)=tanh(\beta xy^T+r)

κ ( x , y ) = t anh ( β x y T + r )

性能度量

交叉验证

简单交叉:通常8:2

k折交叉:分成k份每次取k-1个作训练,剩下的作验证

留一法:令k等于样本数

自助法:m个样本中随机抽一个,重复m次构造训练集,没抽到过的作验证集

混淆矩阵:真实标签和预测标签的矩阵c(i,j)表示实际是i而预测为j的样本数

T P R = T P T P + F N F P R = F P F P + T N \begin{aligned}

TPR=\frac{TP}{TP+FN}

FPR=\frac{FP}{FP+TN}

\end{aligned}

T P R = T P + F N T P F P R = F P + T N F P

AUC:ROC曲线下的面积